人工智能發展愈見成熟,愈多團體為限制技術應用而發聲。除了部分名人早年提出要小心採用人工智能,近年連大型科企也說要規範。Google 更為內部設下人工智能原則,定下道德規範。

Google AI 主管 Jeff Dean 稱,人工智能原則作為 Google 開發人員在研究、應用和產品服務如何發展和應用人工智能的參考指標。 根據人工智能原則審查了過百個項目,亦為過千名員工提供專為機械學習公平而設的培訓。

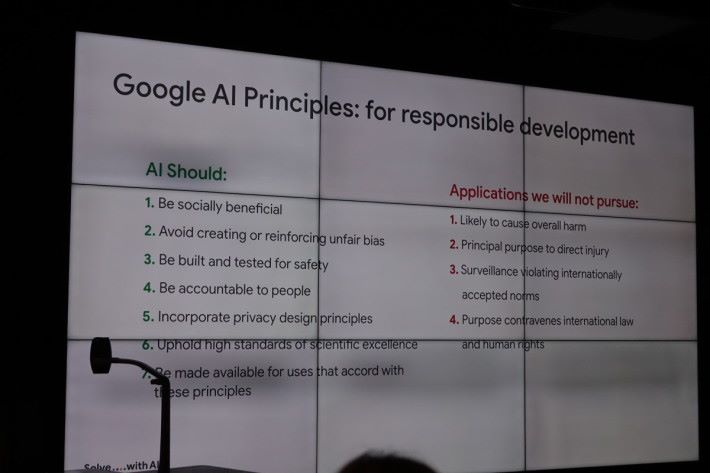

該公司的人工智能原則有七條「應該」和四條「不該」。七條「應該」原則排在首位的是要為裨益社會。

由於人工智能涉及數據和私隱, Jeff 又提到,他們正積極就私隱、安全及公平等作出研究,也研發了全新的機械學習模式「聯合學習」( Federated learning ) 加強保障私隱,讓開發人員能利用更少量的數據訓練模型和完善產品,利用在地電話上的數據就能協同訓練機械學習模型,以避免用戶數據上傳至雲端保存。